Chatbots, enceintes connectées, assistants vocaux… Porté par les progrès fulgurants des IA et le Content Design, le Design Conversationnel ne fait que commencer. Du vocal au textuel, comment fonctionnent ces bots ? Quels enjeux et quels usages ? Quelles bonnes pratiques spécifiques en conception et UX writing ? Quelle place pour le Designer Conversationnel face aux IA ?

Pour faire le point sur le sujet, le dernier épisode de Slash Design a réuni Amina Esselimani (Speak UX) et Hélène Gianessi (Devoteam), deux figures du Design Conversationnel en France.

Passant par les petites fenêtres en bas des sites ou les messageries instantanées, les chatbots nous interpellent : “Bonjour, Je peux vous aider ? ”. On donne des ordres à nos smartphones – Dis Siri, appelle Papa ! – tandis que d’autres parlent à leurs enceintes : OK Google, c’est quand, l’heure d’été ?

Ils nous irritent parfois et ont pu nous décevoir… Pourtant, dès qu’on tend l’oreille, les promesses de ces interfaces qui dialoguent résonnent profondément et pour longtemps ! En s’immisçant dans nos conversations, en comprenant notre langage naturel, en adoptant notre mode de communication ancestral, elles tentent de s’adapter à notre fonctionnement ; jusqu’alors, c’était plutôt l’inverse ! Une reprise de pouvoir de l’homme sur la machine ? se réjouit Rachel Donnat, la Directrice pédagogique du Laptop. En tout cas de quoi faire mentir Steve Jobs qui nous sommait “d’apprendre le langage des ordinateurs, parce que ça apprend à penser.”

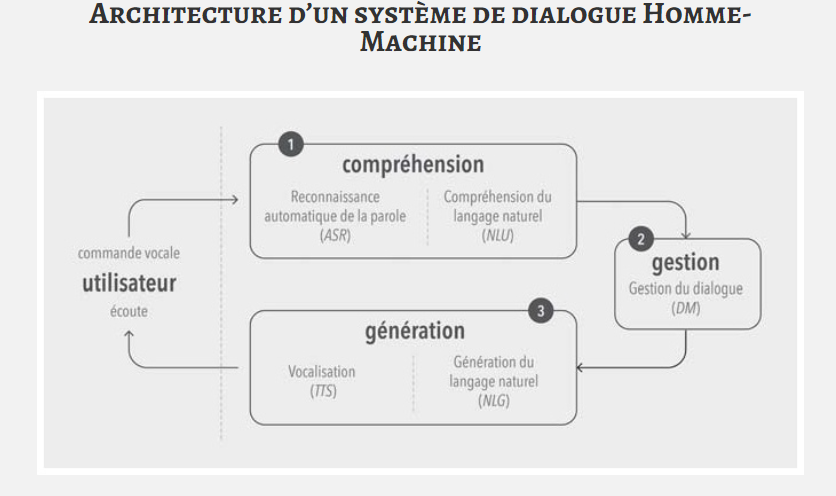

Grâce aux technologies de Natural Language Processing (ou NLP) qui mêlent informatique et linguistique, “les bots savent identifier dans les inputs de l’utilisateur des intentions (réserver un billet), des entités (aller à Paris), des valeurs (les horaires) et y apporter une réponse programmée” explique Amina, fondatrice de Speak UX!, agence et centre de formation dédiés au Conversationnel.

Les interfaces vocales (VUI) impliquent deux briques technologiques supplémentaires :

pour reconnaître les paroles de l’utilisateur – y compris les homonymes ou les expressions imagées – et les convertir en texte afin qu’elles puissent être traitées

pour transformer le texte – dans ce cas, les réponses du bot écrites par le Designer – en paroles artificielles aux intonations de plus en plus humaines.

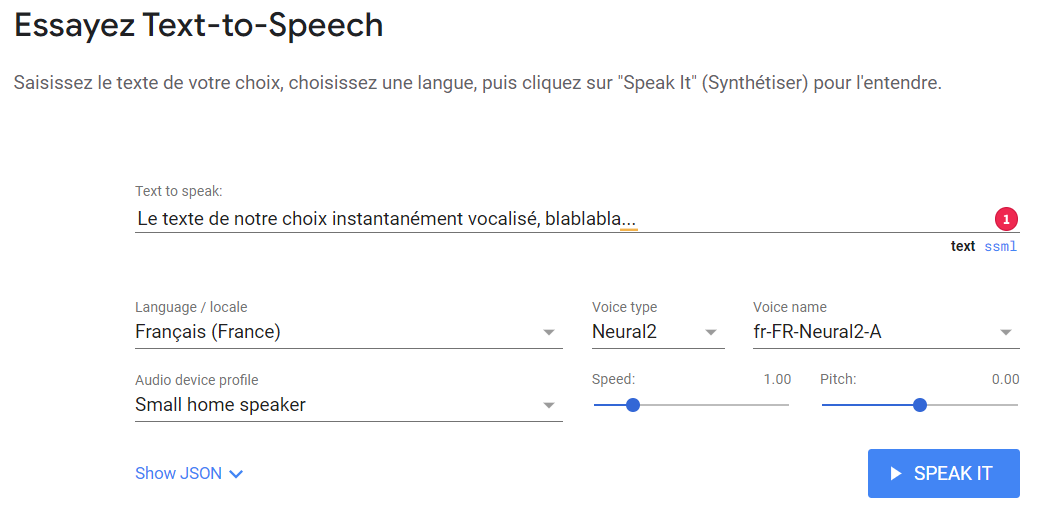

Si l’on dicte de plus en plus de messages à nos téléphones (STT), on est moins habitué à écouter ce que l’on écrit. La démo TTS de Google donne une idée de l’état de l’art en la matière : on peut entendre la version vocalisée de n’importe quel texte copié-collé, en choisissant le timbre de voix, la vitesse d’élocution et l’accent à notre guise !

Les avancées du vocal sont portées par celles de l’intelligence artificielle comme en témoignent, dans des genres bien différents, les principaux évènements parisiens sur le sujet : “Deep Voice, Voix et intelligence artificielle” organisé chaque année par la Sorbonne et Voice Tech Paris, devenu, après trois éditions, Big data et AI en 2022.

Même si les premiers essais ont pu occasionner quelques déceptions, les prévisions internationales des grands cabinets d’études convergent vers un futur radieux pour les chatbots and virtual customer assistants”. Les études montrent également que la génération Z interagit plus facilement avec eux que ses ainés “migrants digitaux”.

En France, les premiers postes de Designers Conversationnel “en titre” sont apparus chez les opérateurs, au premier rang desquels Orange. En tant que consultante UX chez Devoteam Creative Tech, Hélène y a d’ailleurs effectué une mission longue durée. Comme dans tous les domaines émergents, le métier s’exerce encore principalement chez les prestataires. Des agences de design et de communication digitale (comme par exemple Conversationnel) aux spécialistes et offreurs de solutions techniques, reconnaissables pour la plupart à leurs noms de domaines en .ia ou .io (pour input/output) : Tolk.ai, Dydu, Hello My Bot, Botmind, Botnation, Zaion, Smartly.ai etc.

Speak UX!, agence et centre de formation pionniers en conversationnel

Fondé par Amina en 2017, Speak UX! est le pionnier français du Design conversationnel et vocal avec un Centre de formation dédié incontournable dans ce domaine. Le portefeuille clients de l’agence témoigne de la diversité des usages : SNCF, Accor, Schneider Electric, Europcar, Valeo, Leboncoin, ORANGE, BNP Paribas, Caisse des Dépôts et Consignation, Doctolib, Système U…

Réponses à apporter ou tâches à accomplir, les cas d’usage conversationnels pertinents répondent à des besoins récurrents : de la vente en ligne à la relation client ou usager au sens très large (banque, support, assistance technique, services publics…), en passant par des processus administratifs simples pour les salariés de grosses structures.

Au sein des services clients par exemple (un des domaines les plus matures), le recours à un bot réduit le nombre d’appels entrants et les tâches répétitives : les équipes peuvent se consacrer aux demandes complexes, celles pour lesquelles elles apportent une réelle valeur ajoutée. Combinant les avantages de la conversation et de l’automatisation, les bots apportent aux utilisateurs une autonomie appréciable. Dans un épisode de la Room Content Design FR sur Clubhouse, Amina et Maaike Coppens (une autre experte incontournable, voir son ouvrage dans les ressources) évoquent l’accès 24h/24, la possibilité de mettre un processus de dépannage en pause pour le reprendre ultérieurement ou celle de revenir plusieurs fois sur une étape incomprise (alors que l’on hésiterait à reposer la question à un humain).

L’instantanéité constitue l’un des principaux avantages du conversationnel face aux interfaces “traditionnelles” : plus rapide de parler que de taper, et d’entendre ou voir la réponse en temps réel, plutôt que d’avoir à la chercher au fin fond des pages web. Une rapidité telle que les bots sont paramétrés pour temporiser : ils affichent, quelques secondes durant, des typing indicators comme ceux que l’on a l’habitude de voir quand notre interlocuteur saisit son message. Amina évoque également une personnalisation accrue : “Si l’utilisateur est connecté à son compte, on peut utiliser l’historique des usages pour lui proposer des billets à ses horaires habituels, par exemple”.

Si certains parcours arborescents restreignent les possibilités à des choix prédéfinis (souvent sous forme de boutons), la souplesse gagne du terrain, laissant l’utilisateur délivrer les informations dans l’ordre qui lui convient, passer du coq à l’âne ou faire des digressions. Certains chatbots savent récupérer les informations nécessaires à l’accomplissement d’une tâche sans imposer un séquencement précis : si l’utilisateur écrit directement qu’il veut “commander une pizza au fromage pour quatre pour 20h”, le bot lui épargnera les questions “avec quelle garniture”, “pour combien de personnes” et “À quelle heure souhaitez-vous être livré ?”. Interrogé sur le mode de paiement au milieu du tunnel de commande, il pourra répondre sans attendre avant de recentrer le dialogue vers le parcours principal.

La dimension intuitive de l’oral – forme de communication première avant l’écrit – paraît prometteuse en matière d’inclusion : tiendrait-on là une solution pour lutter contre la fracture numérique et l’illectronisme ? Encore faudrait-il que la machine comprenne la façon dont l’utilisateur s’exprime, son niveau de langage, son accent, ce qui est loin d’être le cas. Dans ce domaine comme dans tant d’autres, de gros progrès restent à faire… C’est l’objet de Common voice, le projet participatif de Mozilla qui invite chacune et chacun à “donner sa voix” pour constituer un jeu de données ouvert de nature à réduire les discriminations.

En matière d’accessibilité, le vocal présente de fortes spécificités : inadapté en cas de difficultés auditives et/ou d’élocution, il apporte des solutions et offre de larges perspectives pour les handicaps moteurs et visuels. L’absence d’interaction gestuelle fait des voicebots les interfaces “idéales” lorsque les utilisateurs ont les mains ou les yeux déficients, ou juste occupés par ailleurs. Par exemple en voiture, où les GPS ont d’ailleurs introduit le vocal depuis longtemps maintenant. Amina cite aussi une application qui délivre au chirurgien des données indispensables pendant une opération et enregistre ses actions qu’il décrit en temps réel. Celui-ci revoit, complète et au besoin modifie ensuite le texte généré, ce qui lui permet de rédiger son compte rendu d’opération de façon fiable, précise et rapide.

Le Voice x Sprint, présenté par Maaike Coppens lors d’un webinar du Laptop

Malgré la diversité des acteurs et des secteurs déjà impliqués, “tout reste à inventer, et cela passe par une évangélisation des parties prenantes peu familiarisées au vocal”, estime Maaike Coppens. C’est ce qui l’a amenée à créer le Voice x Design Sprint : adapté du célèbre dispositif de Jake Knapp, ce format intègre une large part de mise en situation et de role plays pour faire vivre les conversations aux participants afin de les acculturer aux spécificités de ces interfaces particulières. Coresponsable d’un programme de recherche sur L’approche conversationnelle du design, au sein de la chaire Innovation publique Sciences Po • Polytechnique • Ensci •INSP, Zoé Aegerter la rejoint quant à la “nécessité de développer nos compétences autant que nos capacités cognitives et réflexives vocales”. La Designer et Chercheuse a lancé Postillon prospectives, une réflexion notamment concrétisée par des design fictions pour frictionner les avenirs technologiques de la parole.

Le Design Conversationnel, c’est avant tout du design avec un cadrage du projet et une solide recherche utilisateur en amont afin d’identifier les pain points et la meilleure interface pour les résoudre. Amina croit au multimodal : des parcours mêlant les interactions vocales, visuelles et gestuelles pour répondre de la façon la plus rapide et fluide possible à l’intention de l’utilisateur en tirant parti des complémentarités. Un bot peut ainsi avoir sa raison d’être à un moment précis du parcours : par exemple, pour qualifier le besoin de l’utilisateur et l’orienter en conséquence vers des ressources ou un humain.

Les deux expertes soulignent la nécessité de limiter le champ d’intervention de l’agent conversationnel à un périmètre précis pour maximiser ses performances. Air France a ainsi lancé deux chatbots distincts : l’un pour répondre aux innombrables questions concernant les bagages ; l’autre inspirationnel, pour aider les utilisateurs à affiner leur choix de destination. En dédiant son bot à la gestion des déchets (sujet qui suscite moult questions), Bordeaux a choisi la stratégie du petit pas – avant de lancer un appel d’offres plus important. Une fois les grandes lignes définies, “on construit le modèle à partir des différentes intentions auxquelles ont fait correspondre les réponses qui constituent la base de connaissance” explique Hélène.

Se pose aussi la question du Bot Persona : il s’agit de définir une identité – a minima, un nom et un genre, souvent une personnalité plus aboutie – sans pour autant forcément humaniser à outrance Dans son avis éclairant sur les agents conversationnels (voir Ressources), le Comité Consultatif National d’Éthique recommande d’ailleurs de limiter leur personnification. Influençant largement les usages – on ne posera pas les mêmes questions à une psychologue qu’à un bon copain ou à une professeure -, le bot persona définit aussi le produit. On en tiendra compte pour choisir la voix, au sens propre (si l’interface est vocale) et figuré (registre de langage, façon de s’exprimer plus ou moins conviviale, etc).

L’art de converser avec une machine

Si les UX Writers Conversationnels rédigent les réponses du bot, ils et elles travaillent aussi à l’anticipation des propos des utilisateurs afin d’augmenter les chances de compréhension par le système. À la lecture ou l’écoute de “Je veux partir à Nantes” le chatbot de la SNCF doit comprendre que l’utilisateur souhaite acheter un billet de train. Quel temps fait-il ? Donne-moi la météo, Est-ce qu’il va faire beau ? Va-t-il pleuvoir ? Quelles sont les prévisions météo ? etc. etc. Il existe de multiples manières d’exprimer la même idée. Les UX Writers associent donc à chaque intention adressée une liste de formulations. En solo ou en atelier – pourquoi pas avec l’aide de ChatGPT – ils entrainent ainsi le bot intensivement tout en restant conscients de leurs biais langagiers. Pour compléter ou supporter ce travail spécifique, il est possible d’acheter des sets entrainement, spécialisés par domaine ou secteur, mais aussi plus généraliste et à gros volume, comme ceux commercialisés par les GAFAM. Dans tous les cas, la qualité du corpus doit être validée et testée par des Ingénieurs en NLU avec lesquels les Designers Conversationnels collaborent étroitement.

Évidemment, rien ne vaut les “vraies phrases de vrais utilisateurs”. Hélène et Amina recommandent donc de lancer le bot dès qu’il comprend 80 % des requêtes sur une petite partie du trafic. Une large part du travail consiste à analyser les dialogues pour identifier de nouvelles formulations afin d’améliorer la compréhension par le robot. Hélène y trouve aussi “une source incomparable d’expression des besoins concernant ces interactions conversationnelles, mais aussi d’autres parties du parcours utilisateur”.

Quels que soient les moyens mis en œuvre, la compréhension a ses limites. Nos intervenantes considèrent comme performant un bot qui traite 90 % des requêtes. Les technologies de Natural Language Understanding (NLU) peinent encore à saisir le second degré ou certaines intentions masquées derrière le sens littéral des mots. Comme entre être humains à l’écrit dès lors que le contexte non verbal fait défaut, remarque Hélène.

Premier contact avec un bot, l’onboarding est fondamental ! Contrairement aux pages web, impossible de survoler le contenu pour se faire une idée. Sans visibilité, les utilisateurs pourraient mal cerner le sujet et perdre leur temps ou nourrir de trop hautes attentes et être déçus. “En quoi puis-je vous aider ?” ne suffit pas : il faut indiquer la finalité précise du bot, de que même sa nature “artificielle” et ses limites en toute humilité (ce que préconise d’ailleurs le Comité Consultatif National d’Éthique, voir leur avis publié en 2021, en Ressources).

Architecture de l’information optimale, clarté, concision… les fondamentaux de l’UX writing s’appliquent au conversationnel avec certaines spécificités. Hélène aborde notamment le bon niveau granularité (longueur et nombre de bulles) pour fluidifier l’expérience (en évitant les gros pavé de textes comme les dialogues hachés).

Les capacités attentionnelles auditives plus restreintes obligent à adapter l’architecture d’information: quand on peut, selon la fameuse loi de Miller, balayer 7 à 10 items du regard pour effectuer un choix, c’est différent à l’écoute. Limiter le nombre d’options à 3 ou 4 options évite que l’utilisateur n’ait oublié la première à la fin de l’énumération. Si le langage parlé diffère largement de l’écrit, celui du chat emprunte aux deux : son caractère synchrone et la petite taille des fenêtres et du chat exigent aussi une concision accrue.

Mais concis ne signifie pas sec ! Comme dans la vraie vie, difficile d’entamer une conversation sans quelques messages anodins ! Ce small talk est également important lorsque les utilisateurs titillent le bot avec des questions qui ne concernent pas directement le service. Lié à la voix – donc à la personnalité (voir plus haut) – le ton doit être engageant, mais aussi s’adapter au contexte et idéalement au comportement de l’utilisateur. Si les échanges semblent tendus, mieux vaut éviter un enthousiasme excessif susceptible d’envenimer les choses et adopter une posture neutre.

Professeur et chercheur en IA, Laurene Devillers explique à l’occasion d’un TEDx ses travaux menés au sein du CNRS pour détecter les émotions des utilisateurs en observant le timbre, la hauteur, le volume ou le rythme (courte démo à partir de 4:40). Les voicebots pourraient ainsi adapter leur comportement en conséquence, et passer la main à un humain si l’utilisateur semble très énervé.

Pour l’instant, conscients de la forte dimension émotionnelle induite par ce mode de communication , les Designers conversationnels soignent les feedbacks – “Très bien. Entendu. Parfait” – ou “Voulez-vous dire ceci ?” ou encore : “Je suis désolé, je n’ai pas compris votre question . Pourriez-vous la reformuler en phrases courtes ?” Sachant qu’au bout d’une ou deux tentatives infructueuses, le système est généralement programmé pour proposer une porte de sortie, souvent de nature humaine.

Et ChatGPT alors ? Quel est son impact à court terme sur les interfaces conversationnelles ? Si impressionnantes soient ses performances technologiques et la diversité des sujets couverts, le célèbre bot d’Open AI n’est pas aujourd’hui en mesure de répondre aux besoins des utilisateurs d’un service précis. Tout simplement parce qu’il n’est pas fait pour ça. Son rôle consiste à générer des synthèses à partir d’un immense corpus de texte généraliste : pas grand chose à voir avec un chatbot conçu pour un acteur donné qui doit apporter une réponse pertinente à un besoin spécifique sur la base de données maitrisées. Avec de telles attentes de la part des commanditaires, la conception d’un chatbot repose encore, on l’a vu, essentiellement sur le travail des UX Designers et des UX Writers. Ceux-ci restent, selon Zoé Aegerter, le “maillon manquant entre l’usager et l’IA”.

Sans doute que demain les progrès des IA génératrices auto-apprenantes autoriseront les Designers à délaisser leur rôle de dialoguiste. Restera à identifier le besoin, penser le parcours, concevoir le produit, définir l’automatisation, superviser l’entrainement. Et surtout à inculquer à ces agents pas si intelligents que ça des règles pour éviter les dérives que l’on sait. Des dérives racistes et conspirationnistes produites engendrés par les mécanismes de deep learning associés aux tendances transgressives, voire déviantes des humains. Tombées dans le piège, les IA de Microsoft (en 2016) et Meta (en 2022) ont dû être suspendues au bout de quelques heures pour l’une et quelques jours pour l’autre. Si ChatGPT semble aujourd’hui épargné, ce n’est “que” grâce à un filtre permettant, moyennant une labellisation humaine opérée dans des conditions scandaleuses, de limiter la toxicité de l’algorithme. Ces dérapages successifs récents appellent une vigilance accrue quant à la mise en place d’indispensables garde-fous responsables et éthiques dès la conception des IA : encore une affaire de design !

La route est longue et les embûches multiples pour apprendre aux machines à converser et à s’adapter à notre façon de parler, sans pour autant reproduire nos défauts et nos vices. Mais, on peut, comme Rachel, voir dans la dimension “naturelle” du conversationnel l’expression la plus pure du design centré sur l’utilisateur”.

Muriel Gani

>> Pour regarder ou écouter l’’épisode en entier

>> Nos invités

Amina Esselimani est la fondatrice de Speak UX, agence française pionnière dans le Design Conversationnel et centre de formation

Hélène Gianessi est consultante en UX et formatrice chez Devoteam Creative Tech, spécialiste du Design Conversationnel.

>> Tous les épisodes de Slash Design, l’émission imaginée par Pauline Thomas et Ambroise Carrière pour questionner les nouveaux champs du Design

Design Conversationnel, Maaike Coppens, Editions Eyrolles 2022

Premier livre français dédié au Design Conversationnel, préfacé par Amina Esselimani

La révolution des assistants vocaux Oxana Gouliaéva, Eric Dosquet, Yvon Moysan, Dunod, 2020

Talk to Me, James Vlahos, Mariner Books, 2019

Designing Voice User Interfaces, Cathy Pearl, O’Reilly, 2016

L’art de converser avec une machine : quand le Designer devient dialoguiste

Zoé Aegerter, Guillaume Foissac, Sciences du Design, 2019

Agents conversationnels : enjeux d’éthique, Comité national pilote d’éthique du numérique (CNPEN) sous l’égide du Comité National d’Éthique du Numérique), 2021

À votre écoute : exploration des enjeux éthiques, techniques et juridiques des assistants vocaux Livre blanc CNIL, 2020

Dans le cadre du projet HyperVoix mené par la FING en 2019 :

Deux épisodes de Design Master Class avec Zoé Aegerter, Ulysse Bottello et Maaike Coppens, 2019

Conversation Design, état des lieux, Amina Esselimani et Maaike Coppens dans la Room Content Design FR sur Clubhouse (2022)

Chatbot : derrière le robot, des humains Hélène Gianessi au micro d’UX Content Craft, 2021

Voice x Design Sprint, Maaike Coppens et Pauline Thomas, Webinar Le Laptop, 2020

Les slides de Maaike

Dernière modification de cette page : 16 janvier 2024, 17:54

FIGMA, UI DESIGN, ACCESSIBILITÉ NUMÉRIQUE

Découvrir